Gesetz der großen Zahlen

Als Gesetze der großen Zahlen, abgekürzt GGZ, werden bestimmte Grenzwertsätze der Stochastik bezeichnet.

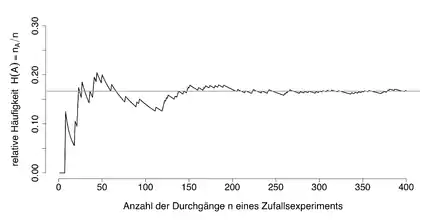

In ihrer einfachsten Form besagen diese Sätze, dass sich die relative Häufigkeit eines Zufallsergebnisses in der Regel um die theoretische Wahrscheinlichkeit eines Zufallsergebnisses stabilisiert, wenn das zugrundeliegende Zufallsexperiment immer wieder unter denselben Voraussetzungen durchgeführt wird. Die häufig verwendete Formulierung, dass sich die relative Häufigkeit der Wahrscheinlichkeit „immer mehr annähert“, ist dabei irreführend, da es auch bei einer großen Anzahl von Wiederholungen Ausreißer geben kann. Die Annäherung ist also nicht monoton.

Formal handelt es sich um Aussagen über die Konvergenz des arithmetischen Mittels von Zufallsvariablen, zumeist unterteilt in „starke“ (fast sichere Konvergenz) und „schwache“ (Konvergenz in Wahrscheinlichkeit) Gesetze der großen Zahlen.

Beispiel: Wurf einer Münze

Die Wahrscheinlichkeit, dass eine Münze beim Werfen Kopf zeigt, betrage ½. Je häufiger die Münze geworfen wird, desto unwahrscheinlicher wird es, dass der Anteil der Würfe, bei denen Kopf erscheint (also die relative Häufigkeit des Ereignisses „Kopf“), um mehr als einen beliebigen vorgegebenen Wert von der theoretischen Wahrscheinlichkeit ½ abweicht. Dagegen ist es durchaus wahrscheinlich, dass die absolute Differenz zwischen der Anzahl der Kopf-Würfe und der halben Gesamtzahl der Würfe anwächst.

Insbesondere besagen diese Gesetze der großen Zahlen nicht, dass ein Ereignis, welches bislang unterdurchschnittlich eintrat, seinen „Rückstand“ irgendwann ausgleichen und folglich in Zukunft häufiger eintreten muss. Dies ist ein bei Roulette- und Lottospielern häufig verbreiteter Irrtum, die „säumige“ Zahl müsse nun aber aufholen, um wieder der statistischen Gleichverteilung zu entsprechen. Es gibt daher kein Gesetz des Ausgleichs.

Ein Beispiel dazu: Angenommen, eine Serie von Münzwürfen beginne mit „Kopf“, „Zahl“, „Kopf“, „Kopf“. Dann wurde „Kopf“ bis dahin dreimal geworfen, „Zahl“ einmal. „Kopf“ hat gewissermaßen einen Vorsprung von zwei Würfen. Nach diesen vier Würfen ist die relative Häufigkeit von „Kopf“ ¾, die von „Zahl“ ¼. Nach 96 weiteren Würfen stelle sich ein Verhältnis von 47 Mal „Zahl“ zu 53 Mal „Kopf“ ein. Der Vorsprung von „Kopf“ ist also nach 100 Würfen sogar noch größer als nach vier Würfen, jedoch hat sich der relative Abstand von „Kopf“ und „Zahl“ stark verringert, genauer – und das ist die Aussage des Gesetzes der großen Zahlen – der Unterschied der relativen Häufigkeit von „Kopf“ zum Erwartungswert von „Kopf“: Der Wert liegt sehr viel näher beim Erwartungswert 0,5 als ¾ = 0,75.

Schwaches Gesetz für relative Häufigkeiten

Der einfachste Fall eines Gesetzes der großen Zahlen, das schwache Gesetz für relative Häufigkeiten, ist das Hauptergebnis in Jakob I Bernoullis Ars Conjectandi (1713).[1] Ein Zufallsexperiment mit genau zwei Ausgängen, genannt Erfolg und Misserfolg, also ein Bernoulli-Experiment, werde Mal unabhängig wiederholt. Bezeichnet die Erfolgswahrscheinlichkeit bei einer einzelnen Durchführung, dann ist die Anzahl der Erfolge binomialverteilt mit den Parametern und . Für den Erwartungswert von gilt dann und für die Varianz .

Für die relative Häufigkeit folgt daraus und . Die Tschebyscheff-Ungleichung angewendet auf lautet damit

für alle . Da die rechte Seite der Ungleichung für gegen null konvergiert, folgt

- ,

das heißt, für jedes noch so kleine geht die Wahrscheinlichkeit, dass die relative Häufigkeit der Erfolge nicht im Intervall liegt, gegen null, wenn die Anzahl der Versuche gegen unendlich geht.

Schwaches Gesetz der großen Zahlen

Man sagt, eine Folge von Zufallsvariablen mit genüge dem schwachen Gesetz der großen Zahlen, wenn für

für alle positiven Zahlen gilt:

also wenn die arithmetischen Mittel der zentrierten Zufallsvariablen in Wahrscheinlichkeit gegen konvergieren.

Es gibt verschiedene Voraussetzungen, unter denen das schwache Gesetz der großen Zahlen gilt. Dabei werden teils Forderungen an die Momente oder an die Unabhängigkeit gestellt. Bedeutsame Voraussetzungen sind:

- Sind paarweise unabhängige Zufallsvariablen, die identisch verteilt sind und deren Erwartungswert existiert, dann gilt das schwache Gesetz der großen Zahlen.

- Sind paarweise unkorrelierte Zufallsvariablen und ist die Folge ihrer Varianzen beschränkt, so gilt das schwache Gesetz der großen Zahlen.

Weitere Formulierungen finden sich im Hauptartikel. Insbesondere lässt sich in der zweiten Aussage die Forderung der Beschränktheit der Varianzen etwas allgemeiner fassen.

Starkes Gesetz der großen Zahlen

Man sagt, eine Folge von Zufallsvariablen mit genüge dem starken Gesetz der großen Zahlen, wenn für

gilt:

- ,

also wenn die arithmetischen Mittel der zentrierten Zufallsvariablen fast sicher gegen 0 konvergieren.

Das starke Gesetz der großen Zahlen gilt beispielsweise, wenn einer der folgenden Fälle zutrifft:

- Die sind paarweise unabhängig und identisch verteilt mit endlichem Erwartungswert.

- Die sind paarweise unkorreliert und es ist .

Das starke Gesetz der großen Zahlen impliziert das schwache Gesetz der großen Zahlen. Eine allgemeinere Form des starken Gesetzes der großen Zahlen, die auch für abhängige Zufallsvariablen gilt, ist der individuelle Ergodensatz und der Lp-Ergodensatz, beide gelten für stationäre stochastische Prozesse.

Interpretation der formalen Aussagen

Anders als bei klassischen Folgen, wie sie in der Analysis untersucht werden, kann es in der Wahrscheinlichkeitstheorie in der Regel keine absolute Aussage über die Konvergenz einer Folge von Zufallsergebnissen geben. Der Grund hierfür ist, dass zum Beispiel bei einer Serie von Würfelversuchen Folgen von Zufallsergebnissen wie 6, 6, 6, … nicht ausgeschlossen sind. Bei einer solchen Folge von Zufallsergebnissen würde die Folge der daraus gebildeten arithmetischen Mittel aber nicht gegen den Erwartungswert 3,5 konvergieren. Allerdings besagt das starke Gesetz der großen Zahlen, dass das Ereignis, bei dem die arithmetischen Mittelwerte nicht gegen den Erwartungswert 3,5 konvergieren, die Wahrscheinlichkeit 0 besitzt. Man nennt ein solches Ereignis auch fast unmögliches Ereignis.

Gegenstand der Gesetze der großen Zahlen ist die zu einer gegebenen Folge von Zufallsvariablen gebildete Folge der arithmetischen Mittel der zentrierten Zufallsvariablen

Aufgrund der beschriebenen Problematik muss die formale Charakterisierung der Konvergenz dieser Folge gegen den Wert 0 nicht nur, wie bei einer klassischen Folge von Zahlen, von einem beliebig klein vorgegebenen Toleranzabstand ausgehen. Zusätzlich wird eine beliebig kleine Toleranzwahrscheinlichkeit vorgegeben. Die Aussage des schwachen Gesetzes der großen Zahlen bedeutet dann, dass zu jeder beliebigen Vorgabe eines Toleranzabstands und einer Toleranzwahrscheinlichkeit bei einem genügend groß gewählten Index eine Abweichung , die den Toleranzabstand überschreitet, höchstens mit der Wahrscheinlichkeit eintritt. Demgegenüber bezieht sich das starke Gesetz der großen Zahlen auf das Ereignis, dass irgendeine der Abweichungen den Toleranzabstand überschreitet.[2]

Praktische Bedeutung

- Versicherungswesen

- Das Gesetz der großen Zahlen hat bei Versicherungen eine große praktische Bedeutung. Es erlaubt eine ungefähre Vorhersage über den künftigen Schadensverlauf. Je größer die Zahl der versicherten Personen, Güter und Sachwerte, die von der gleichen Gefahr bedroht sind, desto geringer ist der Einfluss des Zufalls. Das Gesetz der großen Zahlen kann aber nichts darüber aussagen, wer im Einzelnen von einem Schaden getroffen wird. Unvorhersehbare Großereignisse und Trends wie der Klimawandel, die die Berechnungsbasis von Durchschnittswerten verändern, können das Gesetz zumindest teilweise unbrauchbar machen.

- Medizin

- Beim Wirksamkeitsnachweis von medizinischen Verfahren kann man es nutzen, um Zufallseinflüsse auszuschalten.

- Naturwissenschaften

- Der Einfluss von (nicht systematischen) Messfehlern kann durch häufige Versuchwiederholungen reduziert werden.

Geschichte der Gesetze der großen Zahlen

Erstmals formuliert wurde ein Gesetz der großen Zahlen durch Jakob I Bernoulli im Jahr 1689, wobei die posthume Veröffentlichung erst 1713 erfolgte. Bernoulli bezeichnete seine Version des schwachen Gesetzes der großen Zahlen als Goldenes Theorem. Die erste Version eines starken Gesetzes der großen Zahlen für den Spezialfall eines Münzwurfs wurde 1909 durch Émile Borel veröffentlicht. 1917 bewies Francesco Cantelli als Erster eine allgemeine Version des starken Gesetzes der großen Zahlen.[3]

Einen gewissen Abschluss erlangte die Geschichte des starken Gesetzes der großen Zahlen mit dem 1981 bewiesenen Satz von N. Etemadi.[4] Der Satz von Etemadi zeigt die Gültigkeit des starken Gesetzes der großen Zahlen unter der Annahme, dass die Zufallsvariablen integrierbar sind (also einen endlichen Erwartungswert besitzen), jeweils dieselbe Verteilung haben und je zwei Zufallsvariablen unabhängig sind. Die Existenz einer Varianz wird nicht vorausgesetzt.

Literatur

- Jörg Bewersdorff: Statistik – wie und warum sie funktioniert. Ein mathematisches Lesebuch. Vieweg + Teubner, Wiesbaden 2011, ISBN 978-3-8348-1753-2, doi:10.1007/978-3-8348-8264-6.

- Rick Durrett: Probability. Theory and Examples. 3. Auflage. Thomson Brooks/Cole, Belmont CA u. a. 2005, ISBN 978-0-534-42441-1.

- Hans-Otto Georgii: Stochastik. Einführung in die Wahrscheinlichkeitstheorie und Statistik. 4., überarbeitete und erweiterte Auflage. de Gruyter, Berlin u. a. 2009, ISBN 978-3-11-021526-7, doi:10.1515/9783110215274.

- Karl Mosler, Friedrich Schmid: Wahrscheinlichkeitsrechnung und schließende Statistik. 2., verbesserte Auflage. Springer, Berlin u. a. 2006, ISBN 978-3-540-27787-3, doi:10.1007/3-540-29441-4.

- Klaus D. Schmidt: Maß und Wahrscheinlichkeit. Springer, Berlin u. a. 2009, ISBN 978-3-540-89729-3, doi:10.1007/978-3-540-89730-9.

Einzelnachweise

- Norbert Henze: Stochastik für Einsteiger. Eine Einführung in die faszinierende Welt des Zufalls. 10., überarbeitete Auflage. Springer Spektrum, Wiesbaden 2013, ISBN 978-3-658-03076-6, S. 218 f.

- Jörg Bewersdorff: Statistik – wie und warum sie funktioniert. Ein mathematisches Lesebuch. 2011, Kapitel 2.8, S. 103–113.

- Jörg Bewersdorff: Statistik – wie und warum sie funktioniert. Ein mathematisches Lesebuch. 2011, Kapitel 2.7 und 2.8, S. 90–113.

- Nasrollah Etemadi: An elementary proof of the strong law of large numbers. In: Zeitschrift für Wahrscheinlichkeitstheorie und verwandte Gebiete. (Online-Ausgabe: Probability Theory and Related Fields. Continuation of Zeitschrift für Wahrscheinlichkeitstheorie.). Bd. 55, Nr. 1, 1981, S. 119–122, doi:10.1007/BF01013465