Mittlere quadratische Abweichung

Die mittlere quadratische Abweichung, auch erwartete quadratische Abweichung, oder mittlerer quadratischer Fehler genannt, und mit MQA, MQF oder MSE (nach der englischen Bezeichnung englisch mean squared error) abgekürzt, ist ein Begriff der mathematischen Statistik. Sie gibt in der Schätztheorie an, wie sehr ein Punktschätzer um den zu schätzenden Wert streut. Damit ist sie ein zentrales Qualitätskriterium für Schätzer. In der Regressionsanalyse wird sie interpretiert als erwarteter quadratischer Abstand, den ein Schätzer vom wahren Wert hat.

Definition

Gegeben sei ein statistisches Modell sowie ein Punktschätzer

für eine zu schätzende Funktion (im parametrischen Fall die Parameterfunktion)

Dann heißt

die mittlere quadratische Abweichung von . Dabei bezeichnet den Erwartungswert bezüglich des Wahrscheinlichkeitsmaßes . Mittels des Verschiebungssatzes der Varianz folgt die äquivalente Darstellung

- .

Hierbei bezeichnet die Verzerrung des Schätzers, auch Bias genannt.

Für Schätzer, die Werte in einem allgemeinen Entscheidungsraum annehmen, der mit einer Norm versehen ist lässt sich die mittlere quadratische Abweichung definieren als

- .

Interpretation

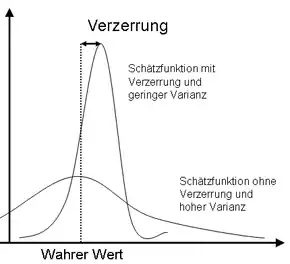

Eine geringe mittlere quadratische Abweichung bedeutet im klassischen Fall, dass gleichzeitig Verzerrung und Varianz des Schätzers klein sind. Man befindet sich mit dem Schätzer also im Mittel in der Nähe des zu schätzenden Funktionals (geringere Verzerrung) und weiß gleichzeitig, dass die Schätzwerte wenig streuen (geringe Varianz) und mit großer Wahrscheinlichkeit auch in der Nähe ihres Erwartungswerts liegen.

Mit dem MSE ist es daher möglich, Schätzverfahren miteinander zu vergleichen. Die Idee ist, dass es vorteilhaft sein kann, einen leicht verzerrten Schätzer zu bevorzugen, der dafür eine wesentlich kleinere Varianz besitzt. Dabei gilt das Schätzverfahren mit dem kleineren MSE in der Regel als das bessere.

Problematisch ist, dass der MSE im Allgemeinen vom zu schätzenden, unbekannten Grundgesamtheitsparameter abhängt.

Beispiel

Ein typischer Fall ist die Schätzung des Mittelwerts einer Normalverteilung. Wir nehmen an, dass Zufallsvariablen existieren, die jeweils normalverteilt mit unbekanntem Erwartungswert und Varianz 1 sind. Der klassische Schätzer ist das Stichprobenmittel . Hier ist die Verzerrung null:

- ,

da der empirische Mittelwert erwartungstreu für ist. Da selbst normalverteilt mit Erwartungswert und Varianz ist, folgt

Konsistenz im quadratischen Mittel

Eine Schätzstatistik heißt konsistent im quadratischen Mittel, falls für gilt[1]

Wirksamkeit von Schätzstatistiken

Gegeben seien zwei Schätzstatistiken und . Die Schätzstatistik heißt MSE-wirksamer, wenn

für alle zulässigen Verteilungen gilt. Des Weiteren wird eine Schätzstatistik als MSE-wirksamst bezeichnet, wenn ihr MSE für alle zulässigen Verteilungen stets der kleinste ist.[2]

Einordnung und verwandte Konzepte

Interpretiert man die Schätztheorie als statistisches Entscheidungsproblem, so ist jeder Punktschätzer eine Entscheidungsfunktion. Die Abweichung der Entscheidungsfunktion von dem zu schätzenden Wert wird dann durch eine Verlustfunktion gewichtet. Diese gibt an, wie groß der "Schaden" ist, der durch eine Schätzung entsteht. Die Verlustfunktion wird dann mit der Entscheidungsfunktion zur Risikofunktion kombiniert, die den mittleren Schaden bei Verwendung einer bestimmten Entscheidungsfunktion angibt.

In diesem Kontext ist die mittlere quadratische Abweichung die Risikofunktion, die bei Verwendung der Gauß-Verlustfunktion

entsteht. Die Risikofunktion wird dann durch Erwartungswertbildung gewonnen.

Bei analoger Konstruktion unter Verwendung des Laplace-Verlustes erhält man den mittleren betraglichen Fehler

- .

Literatur

- mittlere quadratische Abweichung. In: Guido Walz (Hrsg.): Lexikon der Mathematik. 1. Auflage. Spektrum Akademischer Verlag, Mannheim/Heidelberg 2000, ISBN 3-8274-0439-8.

- Hans-Otto Georgii: Stochastik. Einführung in die Wahrscheinlichkeitstheorie und Statistik. 4. Auflage. Walter de Gruyter, Berlin 2009, ISBN 978-3-11-021526-7, doi:10.1515/9783110215274.

- Ludger Rüschendorf: Mathematische Statistik. Springer Verlag, Berlin Heidelberg 2014, ISBN 978-3-642-41996-6, doi:10.1007/978-3-642-41997-3.

- Claudia Czado, Thorsten Schmidt: Mathematische Statistik. Springer-Verlag, Berlin Heidelberg 2011, ISBN 978-3-642-17260-1, doi:10.1007/978-3-642-17261-8.

Einzelnachweise

- Ludwig Fahrmeir, Rita Künstler, Iris Pigeot, Gerhard Tutz: Statistik. Der Weg zur Datenanalyse. 8., überarb. und erg. Auflage. Springer Spektrum, Berlin/ Heidelberg 2016, ISBN 978-3-662-50371-3, S. 344.

- Ludwig Fahrmeir, Rita Künstler, Iris Pigeot, Gerhard Tutz: Statistik. Der Weg zur Datenanalyse. 8., überarb. und erg. Auflage. Springer Spektrum, Berlin/ Heidelberg 2016, ISBN 978-3-662-50371-3, S. 347.