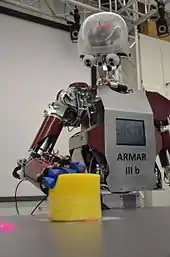

Armar 3

Armar 3 ist ein vom Karlsruher Institut für Technologie entwickelter, völlig autonom handelnder und lernfähiger humanoider Haushaltsroboter, der sich in einer beliebigen Küche zurechtfindet und dort alltägliche Aufgaben erledigen soll.

Projektdaten

Allgemeines

- Entwicklungsort: Karlsruher Institut für Technologie

- Fortbewegung: mittels drei omnidirektionalen Rädern, je um 120° versetzt

- Masse: 250 Kilogramm[1]

- Freiheitsgrade (DOFs): 23[2]

- Energieversorgung: 3 Blei-Säure-Batterien

- Projektbeginn: 2001[3]

- Entwicklungszeit: 7 Jahre[4]

- Projektmitarbeiter: ≈ 60[4] oder ≈ 40[5]

Ausstattung

- Hochleistungsrechner: 5[5]

- Steuerelemente: 12[5]

- Motoren (für den Antrieb): 2 × ≈ 95 Watt[1]

- Kameras: 4 Farbkameras (2 pro Auge)

- Mikrofone: 6

- Flächen-Laserscanner: 3 3D-Flächen-Laserscanner

Kosten

Details

Armar 3 wurde speziell für den Einsatz in der Küche konstruiert, um dem Menschen lästige Alltagsarbeiten (zum Beispiel Spülmaschine einräumen) abzunehmen. Einige Funktionen, beispielsweise das Ein- und Ausräumen der Spülmaschine, beherrschen nur er und sein Bruder.

Antrieb und Energieversorgung

Armar 3 bewegt sich im Gegensatz zu vielen anderen humanoiden Robotern nicht bipedal, sondern mittels drei omnidirektionalen Rädern, die an der Unterseite des Fahrgestells um 120° versetzt montiert sind. Sie ermöglichen es Armar sich unkompliziert in alle Himmelsrichtungen zu bewegen. Den Antrieb bilden zwei 24-Volt-Kollektoren-Gleichstrommotoren mit einer Leistung von je etwa 95 Watt. Außerdem findet eine Untersetzung von 1:36 mittels eines vorgeschalteten Planetenradgetriebes statt.[1] Die nötige Energie – Armar bewegt sich vollkommen autonom, ohne jegliche Stromkabel – bezieht Armar aus drei Blei-Säure-Batterien. Sie befinden sich ebenfalls im Fahrgestell.[1] Armar nutzt neben Elektromotoren auch noch weitere, andere Arbeitsorgane. So enthält die Roboterhand Fluidaktoren (bewegliche Kammern, die mit einem Gas oder einer Flüssigkeit befüllt werden, und sich dann verformen), die vor allem den Vorteil haben, dass sie klein und leicht sind, die Hand aber auch nachgiebig ist und so eine geringere Verletzungsgefahr für den Menschen besteht. Armar ermöglicht dies aber auch, selbst rohe Eier problemlos zu halten.[4]

Zurechtfinden Armars in der Küche

Wie schon oben erwähnt, besitzt Armar drei 3D-Flächen-Laserscanner, mit deren Hilfe er ein 3-dimensionales Bild seiner Küche erstellt, das selbst Menschen mit einbezieht. Die drei Scanner, die vom Unternehmen Sick AG hergestellt wurden, sind je um 120° versetzt zwischen den drei Rollen in einer Höhe von weniger als 15 Zentimetern im Fahrgestell des Roboters eingebaut, damit sie selbst die Fußspitzen einer im Raum befindlichen Person wahrnehmen. Dank des Scanwinkels jedes Scanners, der 180° beträgt, ist Armar 3 in der Lage, seine komplette Umgebung zu „sehen“. Die Reichweite der Laserscanner liegt bei etwa 50 Metern, die Auflösung beträgt etwa 0,5 Winkelsekunden. Damit Armars 3D-Modell der Küche immer aktuell ist, fertigen die 3D-Flächen-Laserscanner 30 Scans pro Sekunde an.[4][1] Zur Erfassung weiterer Lagedaten ist Armar 3 mit optischen Inkrementalgebern ausgestattet, die die Winkellage und Drehzahl der Räder mit einer Auflösung von 500 Impulsen pro Umdrehung erfassen.[1]

Kommunikation mit Armar 3

Armar 3 reagiert sowohl auf englische Sprachbefehle als auch auf Zeigegesten.[4] Darüber hinaus kann er selbst sprechen, ebenfalls in Englisch. Die akustischen Signale nimmt er mittels sechs Mikrofonen wahr. Dabei erkennt er sowohl andere störende Schallquellen als auch wichtige Schallquellen, die in einer Küche entstehen. Diese kann er herausrechnen und so die Sprachbefehle eindeutig wahrnehmen. Armar 3 kann auch genau dreidimensional lokalisieren, wer gerade spricht und wo er/sie spricht. Die Zeigegesten nimmt er mittels seiner vier Farbkameras ‒ jeweils eine für nahe Objekte und eine für weiter entfernte Objekte pro Auge ‒ wahr, mit deren Hilfe er auch dreidimensional sehen kann. Die Augen dienen ebenfalls der Gesichtserkennung bzw. der Kamera-Nachverfolgung von Gesichtern und können sogar Personen lokalisieren, dienen aber nicht der Navigation in der Küche. Dafür sind ausschließlich die Flächen-Laserscanner verantwortlich (siehe Zurechtfinden Armars in der Küche).[3][4]

„Wissen“ Armars

Da Armar auf Sprechsignale reagieren soll und dann auch wissen muss, was er zu tun hat, hat Armar 3 eine Art Datenbank, in der sämtliche Objekte – Tassen, Becher, Packungen, und so weiter – gespeichert sind und zwar als viele Bilder aus mehreren, unterschiedlichen Perspektiven, damit Armar sie auch in seiner Küche findet. Zu jedem in der Datenbank erfassten Objekt ist aber nicht nur gespeichert, wie das Objekt heißt und wie es aussieht, sondern auch noch, wie man es behandeln darf, welche Eigenschaften es aufweist und welchen Nutzen es hat. Dazu wurde mittels eines Datenhandschuhs und Motion Capture bestimmte Bewegungen eines Objektes erfasst. Dazu greift man zum Beispiel eine Tasse mit der Hand, bzw. dem Datenhandschuh, und führt unter anderem die Maximalbewegungen mit diesem Objekt aus, man hält also die Tasse im maximalen Neigungswinkel, oder bewegt sie mit Maximalbeschleunigung in eine bestimmte Richtung. Anhand dieser Daten weiß Armar 3 dann immer, wie er mit dem gegriffenen Objekt umgehen darf.[4] Doch auch die einzelnen Bewegungsabläufe – Arm ausstrecken, Objekte greifen, … – sind im Roboter gespeichert. Dazu musste aber nicht unbedingt alles am Anfang in sein Programm geschrieben werden, sondern Armar 3 ist in der Lage, Bewegungsabläufe, die ihm von einem Menschen vorgeführt werden, nachzuahmen und zu speichern, bzw. dann auch wieder in den entsprechenden Situationen anzuführen. Bei der Erkennung der Bewegungen des Menschen, der sie ihm vorführt, orientiert er sich an den Konturen seines Gegenübers. Eine weitere Möglichkeit besteht für die Wissenschaftler darin, mittels Datenhandschuh und Motion Capture einzelne Bewegungsabläufe, unter anderem das Tischdecken, 3-dimensional aufzuzeichnen und schließlich den Roboter mit den dadurch gewonnenen Daten zu füttern. Durch dieses vorherige Vorführen der Bewegungen durch Menschen wird zusätzlich noch verursacht, dass der Roboter sich nachher menschenähnlicher bewegt.[3][4]

Fähigkeiten Armars

Armar 3 ist außerdem in der Lage, einem bestimmte kleinere Gegenstände zu bringen – beispielsweise Tassen, Becher, Reis- oder Saftpackungen. Auch das Holen eines bestimmten Getränks aus dem Kühlschrank ist für Armar 3 kein großes Problem mehr. Welche Sachen er bringen soll, erkennt er anhand des Verpackungsmusters. Neue Gegenstände, die er noch nicht kennt, kann er aber nicht identifizieren. Auch das Tischdecken gehört zu seinen Funktionen. Er beherrscht unter anderem sogar das Ein- und Ausräumen einer Spülmaschine. Dies kann kein anderer Roboter außer ihm.

Ziel des Projektes

Ziel des Projektes ist es laut DFG ScienceTV[6], dass Armar 3 „am Ende […] selbstständig erkennen [soll], was im Haushalt zu tun ist und es macht“.

Weblinks

- DFG Science TV - Die Menschenmaschine (12 Videos über Armar 3)

- Entwurf und Aufbau einer holonomen, mobilen Antriebsplattform für einen humanoiden Serviceroboter (Memento vom 5. Juli 2010 im Internet Archive), PDF-Datei über das Fahrgestell von Armar 3, ODETE und anderen Vorgängern (Armar, Armar 2), doi:10.1007/978-3-642-18986-9_34

- Humanoids and Intelligence Systems Lab - Institut für Anthropomatik (Memento vom 18. Januar 2012 im Internet Archive), Armars „Homepage“

- Armar 3 Video Sammlung auf Youtube

Einzelnachweise

- Entwurf und Aufbau einer holonomen, mobilen Antriebsplattform für einen humanoiden Serviceroboter (Memento vom 5. Juli 2010 im Internet Archive), PDF-Datei über das Fahrgestell von Armar 3, ODETE und anderen Vorgängern (Armar, Armar 2)

- T. Asfour, D.N. Ly, K. Regenstein und R. Dillmann: Coordinated Task Execution for Humanoid Robots http://link.springer.com/chapter/10.1007%2F11552246_25 , 2006

- Helfer im Haushalt – W wie Wissen. In: daserste.de. Abgerufen am 18. Juli 2019.

- DFG ScienceTV - Die Menschenmaschine (Memento vom 2. Juni 2009 im Internet Archive), Inhalte aus den 12 Videos (einzelne Auflistung, welche Informationen in welchem Video sind, in der ältesten Version dieses Artikels)

- Video drehscheibe Deutschland – Digitale Haushaltshilfe in der ZDFmediathek, abgerufen am 22. April 2008. (offline)

- DFG ScienceTV - Die Menschenmaschine (Memento vom 2. Juni 2009 im Internet Archive), Video 01/12