Active Pixel Sensor

Ein Active Pixel Sensor (APS; deutsch aktiver Pixelsensor) ist ein Halbleiterdetektor zur Lichtmessung, der in CMOS-Technik gefertigt ist und deshalb oft als CMOS-Sensor bezeichnet wird. Im Gegensatz zum ebenfalls in CMOS-Technik hergestellten Passive Pixel Sensor enthält jedes Bildelement eine Verstärkerschaltung zum Auslesen von Signalen.

Durch die Verwendung der CMOS-Technik wird es möglich, weitere Funktionen in den Sensorchip zu integrieren, wie beispielsweise die Belichtungskontrolle, die Kontrastkorrektur oder die Analog-Digital-Umsetzer.

CMOS-Sensoren findet man in Smartphones und einigen Digitalkameras, während die Konkurrenztechnologie, CCD-Sensoren, in Videokameras und anderen Digitalkameras verbaut wird.

Funktionsprinzip

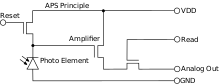

Die einfachste Realisierung eines integrierenden APS-Bildelementes besteht aus einer Photodiode, die in Sperrrichtung betrieben wird, als photosensitives Element und drei n-Kanal-MOSFETs (Feldeffekttransistoren). Zu Beginn der Belichtungsmessung wird die Spannung über der Photodiode mittels des Rücksetz-Transistors auf einen definierten Anfangswert gesetzt, hier , wobei die Schwellenspannung des Transistors ist. Während der nachfolgenden Helligkeitsmessung wird die Sperrschichtkapazität der Photodiode durch den Photostrom entladen. Die Spannung über der Photodiode sinkt dabei proportional zur Bestrahlungsstärke und zur Belichtungszeit. Nach Ablauf der Belichtungszeit wird dieser Spannungswert ausgelesen und einer analogen Nachverarbeitung oder sofort einem Analog-Digital-Wandler zugeführt. Dafür besitzt jedes Bildelement einen Verstärker-Transistor, der mittels des Auswahl-Transistors zumeist spaltenweise auf eine für alle Bildelemente einer Zeile gemeinsame Ausleseleitung geschaltet wird.

Gegenüber CCD-Sensoren besteht dabei der Vorteil, dass die Elektronik direkt das Spannungssignal jedes einzelnen Pixels auslesen kann, ohne die Ladungen verschieben zu müssen, was eine deutlich geringere Neigung zum Blooming zur Folge hat. Der Nachteil ist, dass sich zwischen den lichtempfindlichen Photodioden viel Elektronik befindet, die selbst nicht lichtempfindlich ist, was bei gleicher Chipfläche ursprünglich zu einer im Verhältnis zur CCD-Technik kleineren Lichtempfindlichkeit führte. Da die notwendige Integrationsdichte, um mit CCD konkurrenzfähig zu sein, noch nicht erreicht war, war diese Technik in den 1970er und 1980er Jahren noch bedeutungslos.

CMOS-Sensoren können kompakter und preiswerter produziert werden. Da jeder Pixel direkt adressierbar ist, ist das Pixel-Binning einfacher und das Auslesen wesentlich flexibler und schneller. Es können sogar Teilbilder partiell ausgelesen werden. Außerdem ist die Leistungsaufnahme wesentlich geringer und das Blooming begrenzt. In die in CMOS-Technologie gefertigten Bildsensoren können zudem weitere Funktionseinheiten wie Belichtungskontrolle und Analog-Digital-Umsetzer integriert werden. Vom Aufbau her besteht eine aktive CMOS-Zelle aus einer Photodiode, einem kleinen Kondensator für die Ladungsaufnahme, einem Verstärkerelement und den Datenleitungen für das Auslesen und Rückstellen.

Eine solche aktive Zelle wird als Active Pixel Sensor (APS) bezeichnet. Die Fotozelle erzeugt mittels Photoeffekt eine Spannung, die proportional der Lichtmenge ist, also der Lichtintensität und der Belichtungszeit. Die Ladespannung wird im Kondensator gespeichert und von dem nachgeschalteten MOSFET verstärkt. Ausgelesen wird die verstärkte Ladespannung durch einen Auslesepuls. Sie gelangt von dort als Analogspannung an den verarbeitenden Signalprozessor.

Wie andere Bildsensoren auch, kann der CMOS-Sensor nur hell und dunkel unterscheiden, nicht aber die Farben. Die Farberkennung kann nur über vorgeschaltete Farbfilter erfolgen, die das Licht in seine Primärfarben Rot, Grün und Blau aufteilen. Über ein solchen vorgeschaltetes Farbfilter wird jedem Pixel eines CMOS-Sensors nur Licht einer Grundfarbe zugeführt. Die dafür benutzten Farbfilter, die aus regelmäßig angeordneten roten, grünen und blauen Farbfiltern bestehen, können Bayer-Filter oder Interferenzfilter sein.[1]

Geschichte

Active Pixel Sensors wurden in den 1990er Jahren von Eric Fossum am Jet Propulsion Laboratory erfunden. Er erhielt dafür 2017 den Queen Elizabeth Prize for Engineering.

Wegen der anfänglich nur schlecht verkleinerbaren Ausleseelektronik lag der Füllfaktor, also der Anteil der lichtempfindlichen Fläche an der Gesamtfläche eines Pixels, bei nur 30 Prozent, das heißt, die Ladungsausbeute war gering (somit auch die erzielbare Signalstärke), was zu einem schlechten Signal-Rausch-Verhältnis führte und sich in starkem Bildrauschen bei schlechter Lichtempfindlichkeit äußerte. Diese Nachteile wurden erst später durch intensive Weiterentwicklung in der Miniaturisierung der CMOS-Technik und durch den Einsatz von Mikrolinsen über jedem Bildelement, die das gesamte einfallende Licht auf den lichtempfindlichen Teil lenken, reduziert.[2]

Anwendungsgebiete

AP-Sensoren werden als Bildsensoren in digitalen Fotoapparaten und Videokameras eingesetzt. Sie kommen heute in verschiedenen digitalen Spiegelreflexkameras zum Einsatz. In Mobiltelefonen mit Kamerafunktion kommen praktisch ausschließlich solche Sensoren zum Einsatz.

In Camcordern werden momentan fast ausschließlich CCD-Sensoren eingesetzt, jedoch hat Sony 2005 den HDR-HC1 veröffentlicht, einen High-Definition-Video-Camcorder, der einen AP-Sensor verwendet. AP-Sensoren finden auch in vielen Industriekameras Verwendung. Die Münchener Firma ARRI brachte 2004 mit der D-20 eine Videokamera heraus, die einen AP-Sensor mit einer Bildauflösung von 2880 × 1620 Pixel verwendet. Seine Größe entspricht der aktiven Bildfläche eines 35-mm-Films, was den Einsatz von generischen Filmkameraobjektiven erlauben und die Schärfentiefe der Bilder an die des Filmes angleichen soll. Mitunter wird für jede Grundfarbe ein eigener CMOS-Sensor verbaut (sog. 3MOS-Sensor), sodass auch bei geringerer Helligkeit eine größere Farbsättigung erreicht wird.

Eine Spezialform der CMOS-Bildsensoren stellen die Photodioden-Arrays dar, die quasi ein n×1-CMOS-Bildsensor sind. Sie werden in der Regel nur in Embedded-Anwendungen, das heißt, Anwendungen, bei denen das Bild nicht von Menschen betrachtet oder ausgewertet wird, verwendet. Beispiele dafür sind Barcodelesegeräte und Winkelsensoren.

Farbbildsensoren

Zur Aufnahme eines Farbbildes sind zumindest drei Wellenlängenbereiche des Lichtes separat aufzuzeichnen, üblicherweise den Grundfarben Rot, Grün und Blau zugeordnet. Dies geschieht bei Verwendung eines Sensors häufig durch ein den Pixeln überlagertes Farbfiltermosaik, wie dem Bayer-Muster (engl. Bayer Pattern). Im Gegensatz zu CCD-Sensoren kann man bei CMOS-Sensoren diese Farbtrennung auch in demselben Pixel durchführen, indem drei Photodioden übereinander gestapelt werden, die aufgrund unterschiedlicher Eindringtiefe der verschiedenen Lichtwellenlängen von unterschiedlichen Farben erreicht werden. Kommerziell werden derartige Sensoren von der Firma Sigma unter der Bezeichnung Foveon X3 in Digitalkameras eingesetzt. Eine alternative Bauform mit der Bezeichnung Transverse Field Detector wird erforscht.[3][4]

Unterschiede zu CCD-Sensoren

Anfangs erhoffte man sich eine günstige Produktion bei einem größeren Produktionsvolumen, unter der Annahme, dass die Sensoren ohne Umrüstung auf den für hohe Stückzahlen ausgelegten Fertigungsstraßen gefertigt werden könnten und so einen geringeren Fertigungsaufwand pro Chip verursachen würden. Dies hat sich nicht bestätigt (Stand 2001).[5] Jedoch können und werden in Chips mit Active-Pixel-Sensoren häufig Teile der Peripherieschaltung, wie Analog-Digital-Wandler, Takterzeugung, zeitliche Ablaufsteuerung und Spannungspegelanpassung, integriert, was kompaktere und insgesamt kostengünstige Systeme erlaubt.[5]

Ein prinzipieller Vorteil von APS liegt in dem in jedem Pixel vorhandenen Verstärker, so dass nicht einzelne Verstärker wie bei CCD für mehrere Pixel genutzt werden müssen. Dadurch kann bei einer gegebenen Pixelrate jeder Verstärker mit einer geringeren Bandbreite und somit geringerem Eigenrauschen betrieben werden. So erreichen im Jahr 2013 AP-Sensoren ein Eingangsrauschen von 1–2 Photonen bei einer Bildabtastung von über vierhundert Megapixel pro Sekunde, wobei die Sensoren 4–10 MPixel umfassen und eine Quanteneffizienz von über 70 % aufweisen.[6][7] Überwiegt nur ein Aspekt, können jedoch CCD vorteilhaft sein: Zur Detektion weniger Photonen mit sehr geringem Rauschen werden EMCCD verwendet; CCD können mit Quanteneffizienzen nahe hundert Prozent in einem begrenzten Spektralbereich hergestellt werden, und ihr geringer Dunkelstrom resultiert in einem kleinen Bildrauschen bei sehr langen Belichtungszeiten.

CMOS-Bildsensoren besitzen oft eine höhere Empfindlichkeit im NIR-Bereich (engl. near infra-red, kurzwellige Infrarotstrahlung) als CCD-Sensoren. Bei vielen CMOS-Sensoren liegt das Empfindlichkeitsmaximum im NIR-Bereich (> 650 nm), während CCD-Sensoren das Maximum im sichtbaren Bereich (grünes Licht, 550 nm) besitzen.

Die nachfolgende Auflistung der Vor- und Nachteile von CMOS-Sensoren im Vergleich zu CCD-Sensoren bezieht sich auf allgemeine Aussagen von Standardbauelementen. Spezialisierte Sensoren können in beiden Techniken deutlich abweichende Eigenschaften aufweisen.

Vorteile (der CMOS-Sensoren):

- Geringerer Stromverbrauch

- Geringere (Geräte-)Baugröße, durch Integration der Auswertelogik auf demselben Chip (System on a Chip)

- Manche Verarbeitungsschritte können gleich im Pixelverstärker vorgenommen werden, z. B. Logarithmierung beim HDRC-Sensor (engl. high dynamic range CMOS).

- Durch separate Verarbeitung jedes Pixels (Umwandlung von Ladungen in Spannungen):

Nachteile:

- separate Umwandlung der Ladung in Spannung für jedes Pixel und Integration der Auswertelogik führt zu:

- größeren Empfindlichkeitsunterschieden zwischen den Pixeln (Uniformität) durch Fertigungstoleranzen, was bei Bayer-Sensoren zu einem stärkeren Farbrauschen führt, und

- einem geringeren Füllfaktor (Verhältnis der lichtempfindlichen zur gesamten Pixelfläche), mit der Folge einer insgesamt schlechteren Lichtempfindlichkeit.

Siehe auch

Weblinks

- Sensortechnik

- Daniel Göhring: Digitalkameratechnologien: Eine vergleichende Betrachtung CCD kontra CMOS. Humboldt-Universität zu Berlin, 2002 (Seminararbeit; PDF; 1,60 MB)

- Warum die Fotodiode im Sensor keine Ladung sammelt, sondern vernichtet. Eine populärwissenschaftliche (aber exakte) Beschreibung der Vorgänge im CMOS-Pixel für Nicht-Elektroniker.

Einzelnachweise

- Viktor Kuryan: Bildsensoren

- Bruce G. Batchelor: Cameras. In Machine Vision Handbook, Springer-Verlag 2012, ISBN 978-1-84996-168-4, S. 383

- YouTube: Transverse Field Detector

- Eric R Fossum: Comment on Transverse Field Detector

- Dave Litwiller: CCD vs. CMOS: Facts and Fiction (Memento vom 8. April 2011 im Internet Archive) (PDF; 395 kB). In: Photonics Spectra. Nr. 1, 2001, S. 154–158.

- Vu, Paul; Fowler, Boyd; Liu, Chiao; Mims, Steve; Balicki, Janusz; Bartkovjak, Peter; Do, Hung; Li, Wang: High-performance CMOS image sensors at BAE SYSTEMS Imaging Solutions, bibcode:2012SPIE.8453E..0DV.

- Junichi Nakamura: High-resolution, high-frame rate CMOS image sensors for high-end DSC/DVC applications, Aptina (vgl.: Chipworks 6th Annual Image Sensors Conference (Memento vom 6. Mai 2013 im Internet Archive), Blog, 2013)