Kolmogorow-Smirnow-Test

Der Kolmogorow-Smirnow-Test (KS-Test) (nach Andrei Nikolajewitsch Kolmogorow und Nikolai Wassiljewitsch Smirnow) ist ein statistischer Test auf Übereinstimmung zweier Wahrscheinlichkeitsverteilungen.

Mit seiner Hilfe kann anhand von Zufallsstichproben geprüft werden, ob

- zwei Zufallsvariablen eine identische Verteilung besitzen oder

- eine Zufallsvariable einer zuvor angenommenen Wahrscheinlichkeitsverteilung folgt.

Im Rahmen des letzteren (Einstichproben-)Anwendungsproblems spricht man auch vom Kolmogorow-Smirnow-Anpassungstest (KSA-Test). Einige (parametrische) statistische Verfahren setzen voraus, dass die untersuchten Variablen in der Grundgesamtheit normalverteilt sind. Der KSA-Test kann genutzt werden, um zu testen, ob diese Annahme verworfen werden muss oder (unter Beachtung des -Fehlers) beibehalten werden kann.

Konzeption

Das Konzept wird anhand des Anpassungstests erläutert, wobei der Vergleich zweier Merkmale analog ist. Man betrachtet ein statistisches Merkmal , dessen Verteilung in der Grundgesamtheit unbekannt ist. Die zweiseitig formulierten Hypothesen lauten dann:

(Die Zufallsvariable besitzt die Wahrscheinlichkeitsverteilung .)

(Die Zufallsvariable besitzt eine andere Wahrscheinlichkeitsverteilung als .)

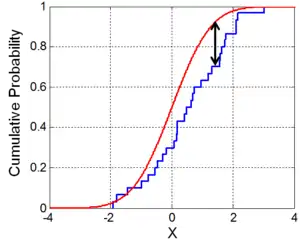

Der Kolmogorow-Smirnow-Test vergleicht die empirische Verteilungsfunktion mit , mittels der Teststatistik

wobei sup das Supremum bezeichnet.

Nach dem Gliwenko-Cantelli-Satz strebt die empirische Verteilung gleichmäßig gegen die Verteilungsfunktion von (also unter gegen ). Unter sollte größer sein als unter . Die Teststatistik ist unabhängig von der hypothetischen Verteilung . Ist der Wert der Teststatistik größer als der entsprechende tabellierte kritische Wert, so wird die Nullhypothese verworfen.

Die Prüfgröße folgt für alle (stetigen) Verteilungen der Kolmogorow-Verteilung.

Vorgehensweise beim Einstichprobenproblem (Anpassungstest)

Von einer reellen Zufallsvariablen liegen Beobachtungswerte () vor, die bereits aufsteigend sortiert sind: . Von diesen Beobachtungen wird die relative Summenfunktion (Summenhäufigkeit, empirische Verteilungsfunktion) ermittelt. Diese empirische Verteilung wird nun mit der entsprechenden hypothetischen Verteilung der Grundgesamtheit verglichen: Es wird der Wert der Wahrscheinlichkeitsverteilung an der Stelle bestimmt: . Wenn tatsächlich dieser Verteilung gehorcht, müssten die beobachtete Häufigkeit und die erwartete Häufigkeit in etwa gleich sein.

Falls stetig ist, kann die Teststatistik auf folgende Weise berechnet werden: Es werden für jedes die absoluten Differenzen

und

berechnet ("o" für oben, "u" für unten), wobei gesetzt wird. Es wird sodann die absolut größte Differenz aus allen Differenzen , ermittelt. Wenn einen kritischen Wert übersteigt, wird die Hypothese bei einem Signifikanzniveau abgelehnt.

Bis liegen die kritischen Werte tabelliert vor.[1] Für größere können sie näherungsweise mit Hilfe der Formel bestimmt werden.[2] Aus dieser Näherungsformel ergeben sich die in der unten stehenden Tabelle aufgeführten Formeln für den Bereich .

Vorgehensweise beim Zweistichprobenproblem

Liegt nun zusätzlich zur obigen Zufallsvariablen eine entsprechende Zufallsvariable vor (mit geordneten Werten ), so kann durch den Zweistichprobentest überprüft werden, ob und derselben Verteilungsfunktion folgen. Die Hypothesen lauten:

Nullhypothese:

(Die Zufallsvariablen und besitzen die gleiche Wahrscheinlichkeitsverteilung.)

Alternativhypothese:

(Die Zufallsvariable besitzt eine andere Wahrscheinlichkeitsverteilung als .)

Der Kolmogorow-Smirnow-Test vergleicht die empirischen Verteilungsfunktionen (relativen Summenfunktionen) und analog zum Einstichprobentest anhand ihrer absoluten Differenzen mittels der Teststatistik

- .

Die Nullhypothese wird bei einem Signifikanzniveau abgelehnt, falls den kritischen Wert überschreitet. Für kleine Werte von und liegen die kritischen Werte tabelliert vor.[3][4] Für große Werte von und wird die Nullhypothese abgelehnt, falls

- ,

wobei für große und näherungsweise als berechnet werden kann.

Zahlenbeispiel

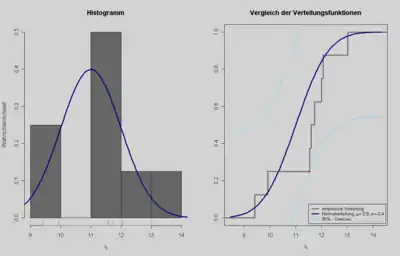

In einem Unternehmen, das hochwertige Parfüms herstellt, wurde im Rahmen der Qualitätssicherung an einer Abfüllanlage die abgefüllte Menge für Flakons gemessen. Es ist das Merkmal : Abgefüllte Menge in ml.

Es soll geprüft werden, ob noch die bekannten Parameter der Verteilung von gelten.

Zunächst soll bei einem Signifikanzniveau getestet werden, ob das Merkmal in der Grundgesamtheit überhaupt normalverteilt mit den bekannten Parametern und ist, also

mit als Normalverteilungssymbol. Es ergibt sich folgende Tabelle:

Hier bezeichnen die -te Beobachtung, den Wert der Summenfunktion der -ten Beobachtung und den Wert der Normalverteilungsfunktion an der Stelle mit den genannten Parametern. Die nächsten Spalten geben die oben angeführten Differenzen an. Der kritische Wert, der bei und zur Ablehnung führte, wäre der Betrag .[1] Die größte absolute Abweichung in der Tabelle ist in der 3. Zeile. Dieser Wert ist größer als der kritische Wert, daher wird die Hypothese abgelehnt. Es ist also zu vermuten, dass die Verteilungshypothese falsch ist. Das kann bedeuten, dass die abgefüllte Menge nicht mehr normalverteilt ist, dass sich die durchschnittliche Abfüllmenge verschoben hat oder auch, dass sich die Varianz der Abfüllmenge verändert hat.

Eigenschaften des KS-Tests

Beim Einstichprobenproblem ist der KS-Test im Gegensatz etwa zum -Test auch für kleine Stichproben geeignet.[5]

Der Kolmogorow-Smirnow-Test ist als nichtparametrischer Test sehr stabil und unanfällig. Ursprünglich wurde der Test für stetig verteilte metrische Merkmale entwickelt; er kann aber auch für diskrete und sogar rangskalierte Merkmale verwendet werden. In diesen Fällen ist der Test etwas weniger trennscharf, d. h. die Nullhypothese wird seltener abgelehnt als im stetigen Fall.

Ein großer Vorteil besteht darin, dass die zugrundeliegende Zufallsvariable keiner Normalverteilung folgen muss. Dies macht den Test vielseitig einsetzbar, bedingt aber auch seinen Nachteil, denn der KS-Test hat allgemein eine geringe Teststärke.

Alternative Tests

Der Lilliefors-Test ist eine Anpassung des Kolmogorow-Smirnow-Tests für die Testung auf Normalverteilung mit unbekanntem Mittelwert und unbekannter Varianz. Mögliche Alternativen zum KS-Test sind der Cramér-von-Mises-Test, der für beide Anwendungsfälle geeignet ist, sowie der Anderson-Darling-Test für den Vergleich einer Stichprobe mit einer hypothetischen Wahrscheinlichkeitsverteilung.

Weblinks

- (Seite nicht mehr abrufbar, Suche in Webarchiven)

- Tabelle mit kritischen Werten

- Online-Version des K-S-Tests

- Online Durchführung des Tests

Literatur

- Lothar Sachs, Jürgen Hedderich: Angewandte Statistik. 12., vollständig überarbeitete und erweiterte Auflage. Springer, Berlin/ Heidelberg 2006, ISBN 978-3-540-32161-3.

Einzelnachweise

- Critical values for the Kolmogorov-Smirnov Test for goodness of fit. Archiviert vom Original am 18. August 2016; abgerufen am 18. Dezember 2016.

- Lothar Sachs, Jürgen Hedderich: Statistik: Angewandte Statistik. 12. Auflage. Springer, Berlin/ Heidelberg 2006, S. 338.

- Pearson E.S. and Hartley, H.O. (Hrsg.): Biometrika Tables for Statisticians, Band 2. Cambridge University Press, 1972, S. 117–123, Tables 54, 55, ISBN 0-521-06937-8.

- Tabelle der kritischen Werte für den Zweistichprobentest (Memento des Originals vom 13. Juni 2013 im Internet Archive) Info: Der Archivlink wurde automatisch eingesetzt und noch nicht geprüft. Bitte prüfe Original- und Archivlink gemäß Anleitung und entferne dann diesen Hinweis. (PDF; 177 kB)

- Jürgen Janssen, Wilfried Laatz: Statistische Datenanalyse mit SPSS für Windows. 6. Auflage. Springer, 2007, S. 569.