Orthogonale Regression

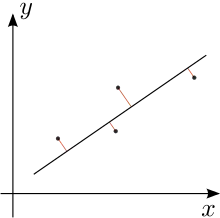

In der Statistik dient die orthogonale Regression (genauer: orthogonale lineare Regression) zur Berechnung einer Ausgleichsgeraden für eine endliche Menge metrisch skalierter Datenpaare nach der Methode der kleinsten Quadrate. Wie in anderen Regressionsmodellen wird dabei die Summe der quadrierten Abstände der von der Geraden minimiert. Im Unterschied zu anderen Formen der linearen Regression werden bei der orthogonalen Regression nicht die Abstände in - bzw. -Richtung verwendet, sondern die orthogonalen Abstände. Dieses Verfahren unterscheidet nicht zwischen einer unabhängigen und einer abhängigen Variablen. Damit können – anders als bei der linearen Regression – Anwendungen behandelt werden, bei denen beide Variablen und messfehlerbehaftet sind.

Die orthogonale Regression ist ein wichtiger Spezialfall der Deming-Regression. Sie wurde erstmals 1840 im Zusammenhang mit einem geodätischen Problem von Julius Weisbach angewendet[1][2], 1878 von Robert James Adcock in die Statistik eingeführt[3] und in allgemeinerem Rahmen 1943 von W. E. Deming für technische und ökonomische Anwendungen bekannt gemacht.[4]

Rechenweg

Es wird eine Gerade

gesucht, die die Summe der quadrierten Abstände der von den zugehörigen Fußpunkten auf der Geraden minimiert. Wegen berechnet man diese quadrierten Abstände zu , deren Summe minimiert werden soll:

Für die weitere Rechnung werden die folgenden Hilfswerte benötigt:

- (arithmetisches Mittel der )

- (arithmetisches Mittel der )

- (Stichprobenvarianz der )

- (Stichprobenvarianz der )

- (Stichprobenkovarianz der )

Damit ergeben sich die Parameter zur Lösung des Minimierungsproblems:[5][6][7]

Die -Koordinaten der Fußpunkte berechnet man mit

Alternativer Rechenweg

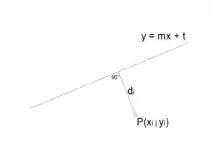

Der geometrische Abstand eines Messpunktes zu einer Ausgleichsgeraden

lässt sich wie folgt berechnen:

Gesucht sind nun die Koeffizienten und mit der kleinsten Summe der Fehlerquadrate.

Berechnung der partiellen Ableitung nach

Die Gleichung

ergibt als Lösung

Dabei wird als der Mittelwert der -Koordinaten der Messpunkte bezeichnet. Analog dazu ist der Mittelwert der -Koordinaten der Messpunkte. Diese Lösung hat auch zur Folge, dass der Punkt stets auf der Ausgleichsgeraden liegt.

Berechnung der partiellen Ableitung nach

Die Gleichung

ergibt folgende quadratische Gleichung:

Dabei sind

- und

die Quadratsummen der Messwerte von und und

die Produktsumme zwischen und .

Auf Grund des Steigungsverhaltens dieser Parabel ergibt sich für das Minimum hier die eine Lösung:

Die Gleichung der geometrischen Ausgleichsgeraden lautet somit:

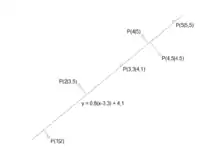

Beispiel

| P1 | 1,0 | 2,0 | −2,3 | −2,1 | 5,29 | 4,83 | 4,41 |

| P2 | 2,0 | 3,5 | −1,3 | −0,6 | 1,69 | 0,78 | 0,36 |

| P3 | 4,0 | 5,0 | 0,7 | 0,9 | 0,49 | 0,63 | 0,81 |

| P4 | 4,5 | 4,5 | 1,2 | 0,4 | 1,44 | 0,48 | 0,16 |

| P5 | 5,0 | 5,5 | 1,7 | 1,4 | 2,89 | 2,38 | 1,96 |

| Summe | |||||||

| Mittelwert |

Es ergibt sich und die geometrische Ausgleichsgerade lautet daher wie folgt:

Einzelnachweise

- J. Weisbach: Bestimmung des Hauptstreichens und Hauptfallens von Lagerstätten. In: Archiv für Mineralogie, Geognosie, Bergbau und Hüttenkunde. 14, 1840, S. 159–174.

- D. Stoyan, T. Morel: Julius Weisbach's pioneering contribution to orthogonal linear regression. In: Historia Mathematica. 45, 2018, S. 75–84.

- R. J. Adcock: A problem in least squares. In: Annals of Mathematics (Hrsg.): The Analyst. 5, Nr. 2, 1878, S. 53–54. JSTOR 2635758. doi:10.2307/2635758.

- W. E. Deming: Statistical adjustment of data. Wiley, NY (Dover Publications edition, 1985), 1943, ISBN 0-486-64685-8.

- P. Glaister: Least squares revisited. The Mathematical Gazette. Vol. 85 (2001), S. 104–107.

- Casella, G., Berger, R. L.: Statistical Inference. 2. Auflage. Cengage Learning, Boston 2008, ISBN 978-0495391876

- J. Hedderich, Lothar Sachs: Angewandte Statistik. Methodensammlung mit R. 15. Auflage. Springer Berlin, Heidelberg 2015, ISBN 978-3662456903