Jordan-Netz

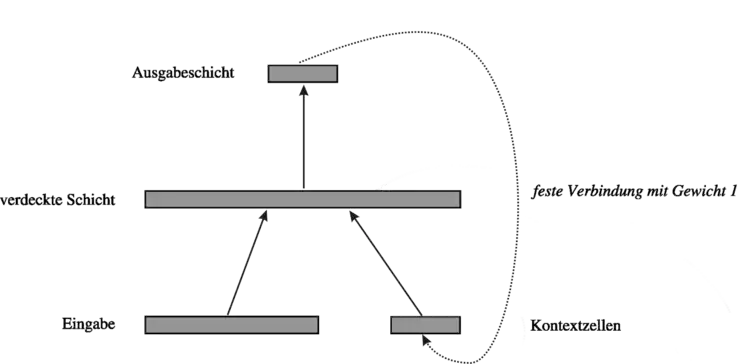

Ein Jordan-Netz (nach Michael I. Jordan) ist ein partiell rückgekoppeltes künstliches neuronales Netz, welches die Ausgabe des Netzes im darauf folgenden Zeitschritt wieder als Teil der Eingabe betrachtet. Wie beim Elman-Netz ist das Jordan-Netz somit in der Lage, Eingaben zu verschiedenen Zeitpunkten zu verarbeiten.

Die Kontextneuronen können zusätzliche Rückkopplungen auf sich selbst aufweisen, womit der Einfluss der älteren Muster gesteuert werden kann. Die Stärke dieser Rückkopplung wird hierbei mit einem festen Erinnerungsfaktor λ gesteuert. Jordan-Netze können beispielsweise mittels Backpropagation trainiert werden, wobei die rückwärts gerichteten Kanten (Rückkopplungen) aber nicht angepasst werden.

Die Struktur des Jordannetzes weist gegenüber dem ähnlichen Elman-Netz den Nachteil auf, dass die Zahl der Rückkopplungen durch die Anzahl der Ausgabeneuronen und somit durch die Problemstellung festgelegt wird.

Bei Elman-Netzen werden anstatt der Ausgabeneuronen die Ausgaben der verdeckten Schicht rückgekoppelt, womit die Einschränkung des Jordan-Netzes aufgehoben wird. Darum werden im Allgemeinen mit Elman-Netzen bessere Resultate erzielt.

Literatur

- Michael I. Jordan: Attractor dynamics and parallelism in a connectionist sequential machine. In: Joachim Diederich (Hrsg.): Artificial neural networks. concept Learning. IEEE Computer Society, Washington, DC 1990, S. 112–127, ISBN 0-8186-2015-3.

- Matthias Haun: Einführung in die rechnerbasierte Simulation Artifiziellen Lebens. expert verlag, Renningen 2004, ISBN 3-8169-1856-5.