Phrasenstrukturgrammatik

Folgende Verbesserungen wären gut: Der vorliegenden WP-Artikelseite wird das Attribut einer "mangelnden Allgemeinverständlichkeit" zugeschrieben. Es wäre daher eine Hilfe, wenn jemand mit Sachverstand sich dieser interdisziplinären Thematik im Grenzbereich zwischen Linguistik und Informatik mal annehmen könnte. Gruß --A.Abdel-Rahim (Diskussion) 06:18, 3. Mär. 2022 (CET)

Der Begriff Phrasenstrukturgrammatik (engl. phrase structure grammar) bezeichnet formale Grammatiken, die nach dem Konstituenten-Prinzip einen Satz schrittweise in kleinere Einheiten zerlegen. Dieses Modell, das im Wesentlichen dem der Konstituentengrammatik entspricht, wird sowohl im Umfeld der theoretischen Informatik als auch der Linguistik verwendet und weist je nach Anwendungsgebiet Detailunterschiede auf. Davon zu unterscheiden ist die Dependenzgrammatik mit ihrer stringenten Mutter-Tochter Zuordnung der Wörter bei der Dekomposition.

Definition der Phrasenstrukturgrammatik

Noam Chomsky definierte die Phrasenstrukturgrammatik formal als eine Menge von Produktionsregeln (=Phrasenstrukturregeln) über einem Alphabet und einer Menge von Anfangs-Zeichenketten.[1] Die Produktionsregeln schränkte Chomsky so ein, dass in einem Ersetzungschritt nur genau ein Symbol einer Zeichenkette ersetzt und dabei nicht gelöscht werden darf. Durch diese Einschränkung entsprechen die Phrasenstrukturgrammatiken den kontextsensitiven Grammatiken.

Die Produktionsregeln sind im Sinne der Chomsky-Hierarchie kontextsensitiv, üblicherweise sogar kontextfrei. Entsprechend werden manchmal auch in der theoretischen Informatik Typ-1- und Typ-2-Grammatiken (also kontextsensitive und kontextfreie) als Phrasenstrukturgrammatiken angesehen.[2] Andere Autoren verstehen aber unter Phrasenstrukturgrammatiken alle uneingeschränkten formalen Grammatiken.[3][4]

Phrasenstrukturregeln

Die Produktionsregeln der frühen Phrasenstrukturgrammatik von Chomsky sind als Phrasenstrukturregeln bekannt. Durch diese Regeln konnte man syntaktische Strukturen nach dem folgenden Schema erzeugen:

- A → B C

Diese Regel legt fest, dass eine Konstituente A durch die Konstituenten B und C ersetzt wird. Anhand dieses Schemas können ganze Sätze erzeugt werden:

- S → NP VP

- NP → D N

- D → das

- N → Kind

- VP → V NP

- V → trinkt

- NP → D N

- D → eine

- N → Kola

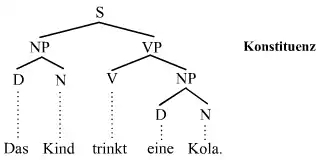

Der Satz (S) gliedert sich in Phrasen (P), in diesem Beispiel eine Nominalphrase (NP) und eine Verbalphrase (VP). Im Beispiel besteht die NP aus einem Determinierer (D) und einem Nomen (N). Die VP besteht im Beispiel aus einem Verb (V) und einer weiteren NP. Mit den Produktionsregeln kann man den folgenden Satz erzeugen: Das Kind trinkt eine Kola. In der Sprachwissenschaft versteht man unter Phrasenstrukturgrammatiken daher Grammatiken, die aus solchen (oder ähnlichen) Regeln bestehen.[5] Man kann die Struktur des Satzes mit dem folgenden Baumdiagramm darstellen; der Baum zeigt wiederum die Ableitungsgeschichte (Derivation) des Satzes:

Dieser Baum zeigt somit auch den Aufbau eines Satzes aus Phrasen und deren weitere Zerlegung bis zu den kleinsten Konstituenten, normalerweise den Wörtern. Dieser Prozess spielt sich nach dem Prinzip der Konstituenz ab, das auch Grundlage der IC-Analyse ist (immediate constituent analysis).[6]

Die folgenden Grammatiken basieren auf dem Konstituenzmodell:

- Phrasenstrukturgrammatiken (= Konstituentengrammatiken)

- Generalized Phrase Structure Grammar

- Head-driven Phrase Structure Grammar

- Kategorialgrammatik

- Lexikalisch-funktionale Grammatik

- Minimalistisches Programm

- Rektions- und Bindungstheorie

Dependenzgrammatiken

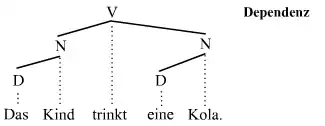

Es gibt Autoren, die streng zwischen Phrasenstruktur- und Dependenzgrammatiken unterscheiden:[7] Während die Erste auf dem Prinzip der Konstituenz aufbaut, geht die Zweite vom Grundsatz der Dependenz aus. In einer Dependenzgrammatik sieht die Zerlegung des obigen Satzes wie folgt aus:

Die folgenden Grammatiken fußen auf dem Prinzip der Dependenz:

- Dependenzgrammatiken

- Bedeutung-Text-Modell

- Extensible Dependency Grammar

- Funktionale generative Beschreibung

- Lexicase Grammar

- Word Grammar

Literatur

- Vilmos Ágel et al. (Hrsg.): Dependenz und Valenz. Handbücher zur Sprach- und Kommunikationswissenschaft 25/1–2, 188–229. Berlin, New York: Mouton de Gruyter, 2003/6.

- David Crystal: Die Cambridge Enzyklopädie der Sprache., Campus Verlag Frankfurt 1993, S. 95–97. ISBN 3-593-34824-1.

- Franz Hundsnurscher: Syntax. In: Lexikon der germanistischen Linguistik. 2., vollständig neu bearbeitete und erweiterte Auflage. Hrsg. v. Hans Peter Althaus, Helmut Henne, Herbert Ernst Wiegand. Niemeyer, Tübingen 1980, S. 211–242. ISBN 3-484-10389-2.

- Theodor Lewandowski: Linguistisches Wörterbuch. Band II. 4., neu bearbeitete Aufl. Quelle & Meyer, Heidelberg 1985. ISBN 3-494-02021-3.

Weblinks

Einzelnachweise

- Noam Chomsky: Three models for the description of language. In: IRE Transactions on Information Theory. Vol. 2, 1956, S. 117 (PDF). PDF (Memento vom 19. September 2010 im Internet Archive)

- D. J. Hand: Artificial Intelligence and Psychiatry. In: The Scientific Basis of Psychiatry. Nr. 1. Cambridge University Press, 1993, ISBN 978-0-521-25871-5 (eingeschränkte Vorschau in der Google-Buchsuche).

- Grzegorz Rozenberg, Arto Salomaa: Word, language, grammar. In: Handbook of Formal Languages. Vol. 1. Springer, 1997, S. 176 (eingeschränkte Vorschau in der Google-Buchsuche).

- Roland Hausser: Mensch-Maschine-Kommunikation in natürlicher Sprache. In: Grundlagen der Computerlinguistik. Springer, Berlin 2000, ISBN 3-540-67187-0, S. 156 (eingeschränkte Vorschau in der Google-Buchsuche).

- Jule Philippi: Einführung in die generative Grammatik. In: Studienbücher zur Linguistik. Band 12. Vandenhoeck + Ruprecht, 2008, ISBN 3-525-26548-4, S. 35 (eingeschränkte Vorschau in der Google-Buchsuche).

- Otto Vollnhals: A multilingual dictionary of artificial intelligence: English, German, French, Spanish, Italian. Routledge Chapman & Hall, 1992, ISBN 0-415-07465-7, S. 185 (eingeschränkte Vorschau in der Google-Buchsuche).

- Was die Dependenzgrammatik betrifft, vgl. Ágel et al. (2003/6)